Hoy anunciamos varios cambios en las normas de uso de la plataforma y en nuestra estructura, para dar respuesta a las muchas peticiones que hemos recibido en esta línea.

Antes de nada conviene explicar hacia dónde va Menéame y el porqué de estos cambios. Menéame es un agregador social, esto significa que por una parte es una herramienta de descubrimiento de contenidos y por otra una comunidad / red social. Estos son nuestros objetivos en las dos áreas:

- Comunidad: uno de los grandes retos de las plataformas a día de hoy es crear una conversación sana, huyendo de la desinformación y del discurso de odio, y a la vez respetando la libertad de expresión. Esto se consigue con unas normas bien definidas, mecanismos para aplicarlas y un algoritmo que premie las aportaciones interesantes y que penalice aquellos que solo buscan generar ruido. En esta línea anunciamos hoy estos cambios, en una línea que será liderada por Remo a partir de ahora.

- Agregación de noticias. El otro reto de Meneáme va de la mano, y es conseguir una herramienta que bajo nuestro punto de vista debe cumplir tres condiciones: 1) que trabaje para el usuario (no que lo convierta en un adicto); 2) que premie el buen contenido y no el clickbait o la desinformación; y 3) que sea de uso masivo. Consideramos que el primer punto lo estamos haciendo bien, el segundo es mejorable y en el tercero queda muchísimo margen de mejora. Y todo ello ante los retos legislativos que se avecinan. Este área será liderada por Daniel Seijo a partir de ahora.

¿Qué es una conversación sana?

Las normas de uso de Menéame están orientadas a propiciar una conversación sana, a la vez que respetuosa con la diversidad de opiniones. Esto es lo opuesto a la tendencia de crispación y confrontación a la que tiende la conversación pública en redes sociales.

Para definir una conversación sana nos queremos basar en los indicadores propuestos por Cortico, una organización de investigación sin ánimo de lucro afiliada con el MIT Media Lab:

- Atención compartida: ¿Estamos hablando de lo mismo?

- Realidad compartida: ¿Tenemos en la cabeza los mismos hechos objetivos?

- Variedad: ¿Estamos expuestos a diferentes opiniones basadas en esa realidad compartida?

- Receptividad: ¿Somos abiertos, cívicos y escuchamos a opiniones distintas a la nuestra?

Además, añadimos un punto importante:

- Intencionalidad: ¿Buscamos crear un debate productivo o únicamente reforzar nuestra opinión y provocar?

¿Cómo crear una conversación sana?

Para crear una conversación sana consideramos que debemos atacar tres áreas. La primera es la de definir qué permitimos y qué no, y trazar los límites de la mejor forma posible. La segunda, establecer los mecanismos correctos de aplicación de esas normas, comunicación con la comunidad y resolución de conflictos.

Estos dos puntos se basan en no permitir, eliminar o penalizar. Pero, ¿cómo impacta con la libertad de expresión aquellos comentarios que deberían ser permitidos pero que generan ruido? Para ese tercer punto tenemos sistemas de autorregulación o de darles menos visibilidad aunque no se eliminen. Lo explicamos en detalle.

Nuevas normas de uso de la comunidad

La primera cuestión importante es que en muchos hilos, no tenemos una conversación sana tal y como la hemos definido anteriormente. Somos conscientes que la autorregulación de voto negativo por parte de usuarios no está funcionando como nos gustaría, y que hay algunos hilos concretos en los que el primer o segundo comentario hacen saltar el debate por los aires

Hay un problema y lo queremos paliar ampliando nuestras normas de uso y realizando unos pequeños ajustes. No son grandes cambios sobre lo que tenemos ahora mismo, pero sí incluyen un análisis más detallado de lo que está permitido y lo que no, definiendo qué es discurso de odio y explicando qué criterios se utilizan para determinar que un comentario pueda ser considerado penalizable.

Existen casos complicados a la hora de distinguir comentarios que se salgan de lo políticamente correcto de aquello que consideramos incitación al odio. Para ello, establecemos tres criterios combinados:

- Demostrabilidad: ¿Podemos aportar fuentes fiables y contrastadas de lo que estamos afirmando?

- Generalización: ¿Estamos hablando de un caso concreto o generalizando hacia una característica protegida?

- Interés informativo frente a incitación a la polémica: ¿Estamos aportando algo al debate o soltando un flame con el objetivo de incendiar la conversación volviendo a un tema polémico?

El saber dónde trazar la línea no es una respuesta única, y es un problema al que también se enfrentan las plataformas masivas como Facebook.

Nueva estructura en la administración y mecanismos de atención al usuario y resolución de conflictos

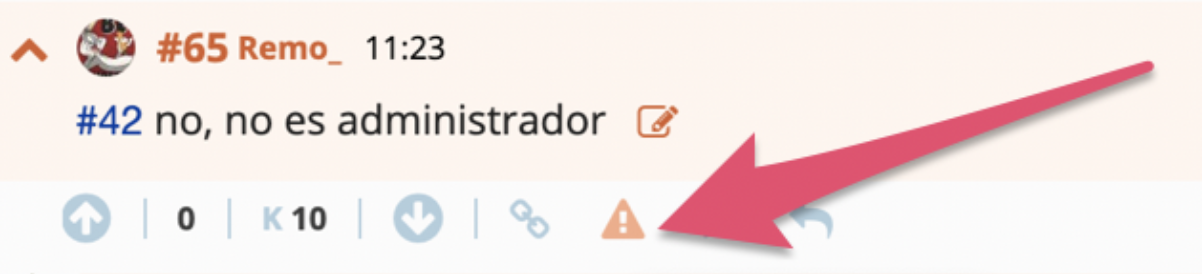

Responsable de comunidad y resolución de dudas: @remo_ será el nuevo responsable de comunidad, encargado de analizar los cambios en las normas de uso y su aplicación. A través de las menciones a @admin o @meneame_net él o alguien de su equipo responderán a dudas sobre las normas y su aplicación.

Asimismo, os comunicamos que los usuarios que actualmente actúan como “voz de la administración” son @patchgirl y @carme.

Información sobre casos concretos: Si un usuario considera que ha sido penalizado injustamente puede escribir a [email protected]. Si la petición es real y no una provocación, intentaremos dar respuesta en el plazo de tiempo más razonable que podamos al motivo por el que se ha producido, y qué apartado o apartados de las normas de uso lo ha provocado.

Comité de resolución de conflictos: A partir de hoy creamos un comité formado por tres admins encargados de solucionar casos dudosos o en los que hayamos podido cometer en un error en la aplicación de las normas. Este comité estará formado por @carme, @remo_, @natrix y otra persona todavía por definir que no sea un admin actual. Este comité tendrá la decisión final sobre la aplicación de las normas.

El usuario o usuarios que quieran cubrir este puesto, pueden escribir a [email protected] para que contemos con ellos.

Equipo de admins (moderadores). Como hasta ahora, serán los encargados de la gestión de la comunidad. Como hasta ahora serán anónimos, salvo aquellos que voluntariamente decidan mostrar su condición de admin.

Más transparencia sobre strikes y sus motivos

Hemos visto que recibimos muchas quejas por dos motivos en teoría contradictorios. El primero, exceso de permisividad (poniendo ejemplos de comentarios que sí han sido penalizados). Otra, exceso de aplicación de las normas.

Para solucionar esto vamos a establecer varios mecanismos en la plataforma, algunos de ellos ya funcionando:

- El usuario puede ver en su perfil qué comentario ha provocado la penalización (ojo, se asocia uno, aunque puede ser por la reiteración de comentarios o comportamientos).

- Todos los usuarios podrán ver si un comentario ha sido motivo de penalización (próximamente), para evitar la sensación de que se permite todo.

Próximos pasos: potenciar el contenido relevante

Una vez tenemos definido qué comentarios no deben estar en la plataforma sigue habiendo un reto. Existen otros comentarios que están al límite: no podemos borrarlos pero no contribuyen a una conversación sana.

Estamos valorando varias acciones que, de forma separada o en conjunto, pueden solucionar este problema:

- Plegar de forma automática los comentarios con karma negativo o que han sido penalizados, y mostrarlos al final de todo. De esta forma respetamos el no borrar comentarios salvo en situaciones muy concretas, pero tampoco les damos visibilidad.

- Una nueva ordenación de comentarios por defecto, que muestre primero los hilos que aportan más información con menos ruido. Estamos haciendo pruebas para comprobar cómo medir esto. Pero partimos de la base de utilizar los votos negativos como métrica (o mejor dicho, la proporción entre positivos y negativos). Observamos que las opiniones encontradas no generan votos negativos entre las dos partes si están bien argumentadas y son respetuosas, sin embargo quien busca provocar suele recibir negativos.

- Un paso más allá en tecnología y algoritmos: Twitter investiga métricas de conversación saludable y Google tiene un sistema de reconocimiento automático llamado Perspective. En esta línea podríamos plantearnos su implementación no para borrar comentarios pero sí para detectar peleas vacías y quitarles visibilidad.

- Repensar el funcionamiento de las opciones de ignorar al usuario, que pueda funcionar como un bloqueo.

Votos negativos

En un futuro próximo esperamos implementar cambios sobre los votos negativos, tanto de comentarios como de noticias. No pueden desaparecer, ya que aportan información relevante y ayudan a filtrar el ruido, pero sí se puede replantear su funcionamiento en algunos aspectos.

Recordatorio: cómo usar el botón de reporte

Para que un comentario sea evaluado debe tener un reporte previo. No se atenderá ninguna petición sobre un comentario que no haya sido reportado previamente, ya que no es posible revisar todos de oficio. Para ello existe un botón debajo de cada comentario.

Enlaces: